Conteúdo exclusivo de empresas parceiras do Portal Medicina S/A. Marcas que transformam e inovam o mercado da saúde.

Eval

O fim da IA Informal: por que a nova resolução nº 2.454 do CFM exige a "IA Corporativa"

Norma redefine a responsabilidade médica e obriga as instituições de saúde a criarem Comissões de Inteligência Artificial.

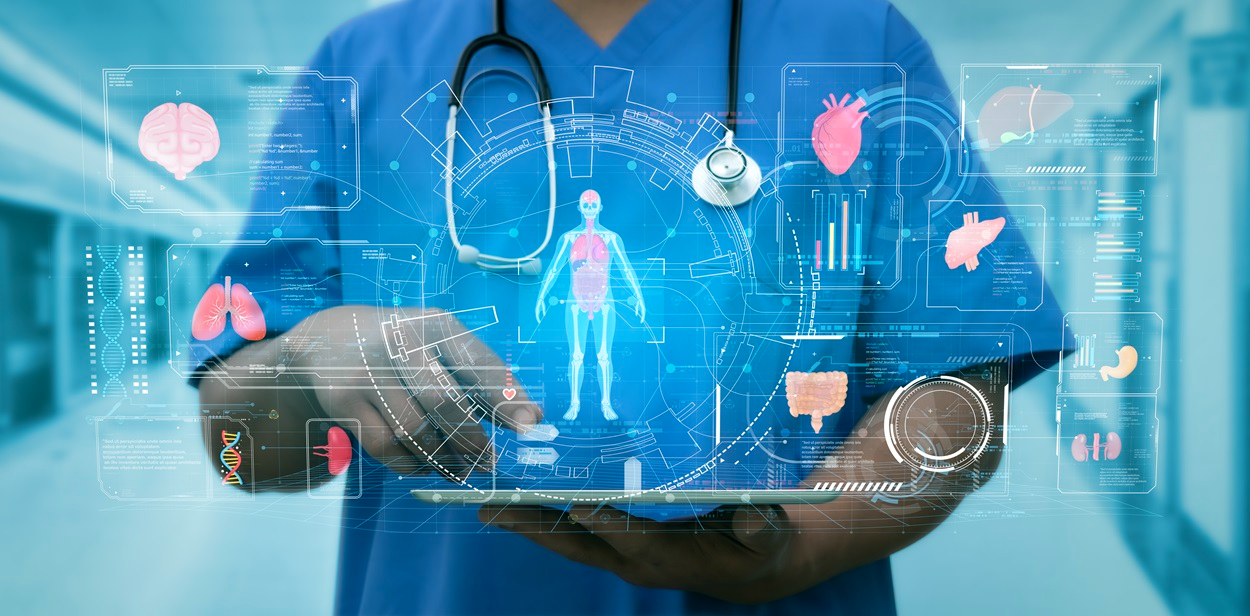

A Inteligência Artificial não é apenas uma nova ferramenta; ela representa uma mudança de paradigma estrutural em diversas áreas da nossa sociedade. É impulsionada por essa transformação que a medicina brasileira acaba de entrar em uma nova era de maturidade digital. Com a publicação da Resolução nº 2.454/2026 pelo Conselho Federal de Medicina (CFM), a inteligência artificial (IA) deixa de habitar um "terreno cinzento" para se tornar uma ferramenta clínica formalmente regulamentada. Esta mudança não é apenas técnica, mas também uma redefinição da responsabilidade médica na era da IA

Mais do que autorizar o uso da tecnologia, a norma estabelece critérios claros de supervisão, responsabilidade e governança institucional. A discussão deixa de ser “se” a IA pode ser utilizada e passa a ser “como” ela deve ser incorporada com segurança e responsabilização.

Diante de uma tecnologia de rápida evolução, o desafio é conhecido: como estimular inovação sem comprometer a segurança do paciente? Na saúde, segurança é princípio inegociável. Ao mesmo tempo, a ausência de diretrizes claras pode gerar uso desestruturado e riscos graves. A nova resolução busca justamente organizar esse cenário, criando parâmetros para um uso responsável e supervisionado.

Conforme estabelece o texto normativo em seu Capítulo VII, Art. 18, § 1º: “em nenhum momento os modelos, sistemas e aplicações de IA na medicina poderão restringir ou substituir a autoridade final do médico”. A norma reforça que a tecnologia tem caráter instrumental e complementar, não substitutivo, na prática assistencial.

- A Resolução 2454/2026: Diagnóstico Humano, Suporte Sintético

Publicada em 27 de fevereiro de 2026, a norma estabelece que a IA deve atuar estritamente como um apoio, e nunca como substituta da decisão clínica. O médico permanece como o “guardião contra a falha da máquina”, sendo o responsável final por acatar ou não as sugestões do sistema.

Na prática clínica diária, essa colaboração se traduz na devolução do bem mais precioso do profissional: o tempo e o foco no paciente. Ao atuar como um verdadeiro assistente que acelera e qualifica processos, a IA ataca de frente a fadiga de documentação que gera esgotamento na classe médica. Quando o médico é libertado da digitação mecânica exaustiva, a relação médico-paciente e a escuta atenta são preservadas e fortalecidas. A máquina processa, o humano valida. Isso não apenas devolve a humanização ao atendimento, como eleva a previsibilidade e a segurança dos registros clínicos.

Principais Pilares e Comparação Internacional:

- Classificação de Risco: A resolução categoriza as ferramentas em níveis de risco: Baixo (administrativo), Médio (apoio diagnóstico com supervisão), Alto (decisões críticas que podem gerar riscos graves no caso de erro).

- Transparência e Consentimento: O paciente tem o direito de saber quando a IA é utilizada em seu cuidado e pode optar pelo uso e como, bem como o profissional médico pode recusar o suporte por IA que considere inseguro ou inadequado.

- Padrões Globais: especialistas apontam que o modelo brasileiro espelha o que há de mais avançado na Europa, nos Estados Unidos e em países com modelos de saúde semelhantes, buscando equilibrar inovação, segurança do paciente, sustentabilidade e respeito às normas jurídicas.

- A Necessidade da “IA Corporativa”: Por que o Comitê Interno é Vital

A prática da Shadow AI, o uso massivo e informal de ferramentas de IA pessoais por equipes de saúde, representa um risco catastrófico de vazamento de dados e decisões baseadas em informações não validadas e testadas.

A resolução do CFM exige que hospitais e instituições criem uma Comissão de IA e Telemedicina. Esta comissão é responsável por:

- Avaliação de Risco: Definir preliminarmente a categoria de cada ferramenta utilizada na instituição.

- Viabilidade: Definir a viabilidade da ferramenta, se ela traz benefícios e como traz benefícios.

- Auditoria Contínua: Monitorar algoritmos para detectar vieses que surgem com o tempo e impactam a assistência.

- Governança de Dados: Garantir conformidade rigorosa com a LGPD e a segurança da informação em saúde.

Sem uma plataforma corporativa centralizada, torna-se impossível realizar a auditoria de logs (prompts e respostas) exigida para garantir que nenhum dado sensível seja processado indevidamente.

- Evalmind: A Resposta à Conformidade Médica e Governança

Os produtos evalmind chat e evalmind care foram desenhados precisamente para preencher o abismo entre a conveniência da IA e as exigências rigorosas da nova resolução. Enquanto ferramentas pessoais oferecem segurança genérica, a plataforma evalmind foca na IA Corporativa Médica através de três pilares fundamentais:

A. Confiança e Auditoria (Compliance com a Resolução)

Diferente das IAs “públicas”, o ecossistema evalmind oferece isolamento e auditoria, garantindo que os dados da sua instituição não sejam usados em outros ambientes.

- Logs Detalhados: Fornece rastreabilidade total de cada interação para as comissões de auditoria exigidas pelo CFM.

- RBAC (Controle de Acesso): Define quem pode acessar quais bases de conhecimento, alinhando-se à TI hospitalar.

B. Inteligência Curada (O Cérebro da Operação)

Para evitar as “alucinações” de modelos genéricos, o evalmind care utiliza a arquitetura corporativa de RAG (Retrieval-Augmented Generation).

- Memória Corporativa: Em vez de preferências pessoais, a IA consulta bibliotecas validadas de protocolos clínicos e políticas de segurança do paciente da própria instituição.

- Comportamento Previsível: Permite testes rigorosos de cenários críticos antes da entrada em produção, garantindo que o médico receba suporte confiável.

C. Eficiência e Integração Estratégica

O evalmind chat não é uma ferramenta isolada; ele se integra de forma segura ao Prontuário Eletrônico (PEP) e sistemas de gestão (ERP).

- SLA de Missão Crítica: Diferente de ferramentas gratuitas, oferece garantia de tempo de atividade e suporte dedicado, essencial para a infraestrutura de saúde.

- Customização via API: Permite criar assistentes específicos para faturamento, triagem, transcrição ou suporte diagnóstico, todos sob o mesmo guarda-chuva de governança.

A Resolução 2454/2026 é clara: o prazo de 180 dias para adequação é um desafio operacional imenso. Adotar uma plataforma de IA corporativa deixa de ser apenas uma decisão tecnológica e passa a representar um caminho estruturado para escalar a inovação com segurança regulatória e responsabilidade institucional.

- A próxima etapa: construir, não apenas adotar

A regulamentação não encerra o debate; estamos somente no começo. Não existe um manual definitivo pronto no mercado. Cada hospital possui sua própria cultura, sistemas legados complexos, protocolos clínicos específicos e níveis distintos de maturidade digital.

A implementação responsável da IA exigirá:

- Integração profunda entre diretorias médicas e de TI, focada na ética e na segurança do paciente;

- Alinhamento estrito com as áreas de compliance e jurídico;

- Arquitetura tecnológica adequada (com isolamento e rastreabilidade), mitigando riscos de vazamento de dados e usos indevidos;

- Testes estruturados em ambientes controlados antes da escala clínica, validando a eficácia clínica.

Mais do que simplesmente comprar tecnologia, será necessário construir modelos institucionais de uso. A nova norma estabelece o “que” precisa ser feito. O “como” ainda será definido pelas instituições que liderarem esse movimento no país. Neste sentido, vale reforçar que, do ponto de vista de investimento, não se deve questionar apenas qual é a “melhor IA”, mas também qual é o “melhor produto”, com foco nos resultados mensuráveis que esta tecnologia pode oferecer.

A redefinição do modo de trabalho mencionada no início deste artigo passa pela etapa de construção de agentes de IA que podem realizar tarefas com maior precisão e qualidade, otimizando o trabalho até então repetitivo e realizado por pessoas, que por sua vez poderão atuar em atividades mais específicas, como ajustando e melhorando o desempenho destes agentes.

Por esta razão, não se trata apenas de plugar ferramentas. Trata-se de desenhar, juntos, a governança que sustentará a medicina digital brasileira na próxima década. Por isso, estamos iniciando um ciclo de diálogo com gestores hospitalares, diretores médicos e líderes de tecnologia interessados em estruturar modelos seguros, auditáveis e escaláveis de Inteligência Artificial.

A era da IA informal terminou. A era da IA governada começou, e ela será construída de forma colaborativa.

____________________

Sobre os autores:

- Rafael Shoji: CEO da Eval.

- Marcelo Giusti Tiziano: Diretor de Produtos da Eval.

- Murilo Rivau Fernandes: Diretor de Novos Negócios da Eval.

- Dr. Leandro Miranda: Médico especialista em Informática em saúde da Eval.

(Nota editorial: Este artigo foi escrito e revisado em colaboração com a IA Gemini 3.1 Pro).

____________________

Entre em contato para estruturarmos juntos o roteiro da sua nova Comissão de IA, baseado nos requisitos corporativos e no suporte de infraestrutura do evalmind.